プラットフォームチーム所属の南です

弊社では有志で勉強会のような場を設けることができます。分科会という呼び方をしているのですが、その中で自分はAlexaスキル開発に参加していました。今回はその活動を通じて学んだことなどを徒然なるままに書きたいと思います。

以前、勉強会でLT枠としても発表したのでその資料も下にリンクしておきます

なぜやるのか?

- 新たな技術分野に乗り遅れないようにするため

- 広まりつつある技術に対し、いつ事業として取り組むことになったとしても乗り遅れないように知見を貯める

- 気楽な気持ちで利用してもらい「学習体験の向上」を目指す

- 教材やPCを準備することなく学習を始めることができる

大きくはこの2点を目的として始動しました。

どのように作るのか?

AlexaのようなVUIを設計するのは初めての経験でした。 そのため以下をまず決定しました。

- なにを作るのか

- リスニングからTrue/Falseを答えるシンプルなスキルを作る

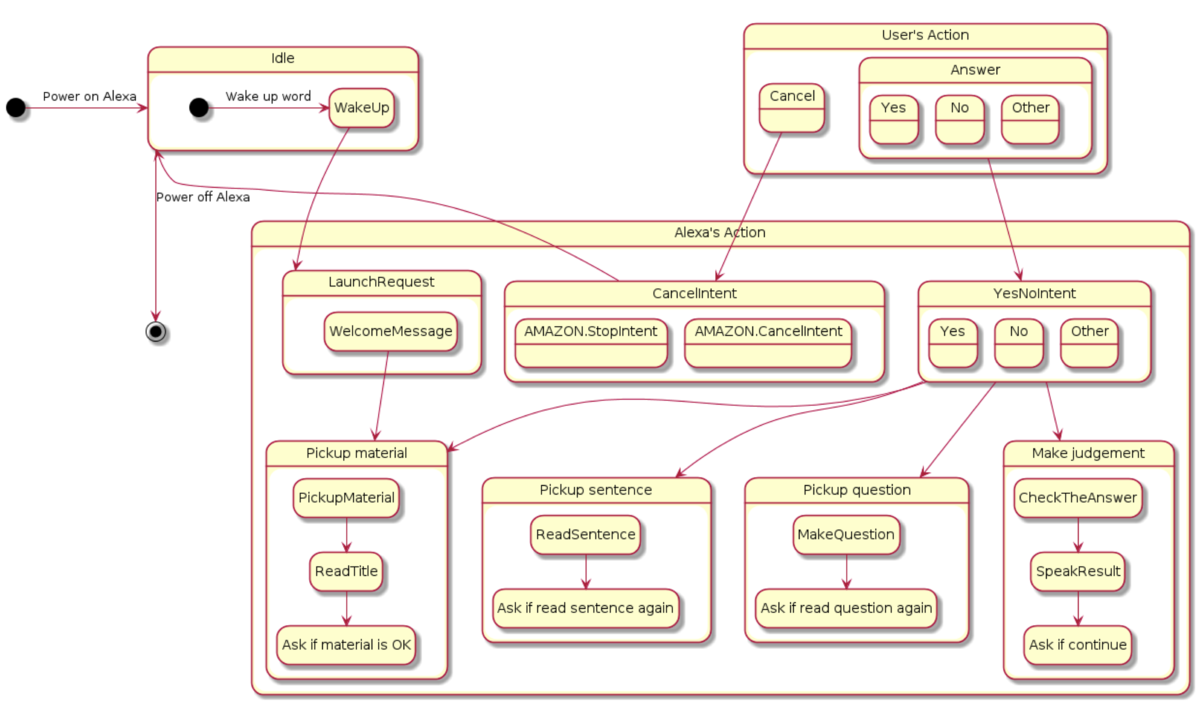

- スタートから終わりまでの道筋

- 目に見えないものを設計する

スタートから終わりまでの道筋

今回の開発ではここに一番時間がかかりました

わかったこと

- 気をつけないといけないことが多い

- 間の取り方や問いかけの回数

- VUIに慣れている人はまだ少ない

- 想定外の返答に対する制御

- シンプルな受け答えで学習を提供できるのは純粋におもしろい

- 手ぶらで受けられるなど、VUIの特性をうまく利用すれば学習体験は向上できる

VUI自体がこれからさらに広まり、声を使った操作に慣れた人が増えてくれば、もっと面白いスキルが作れるように感じました。

最後に

今後、弊社がAlexaスキルをリリースした際は利用して頂けると幸いです。

こんな感じで新しい技術に対しても積極的に取り組むことができるので、興味がある方はとりあえず下のリンクを踏んでくれると嬉しいです。 https://appeal.rarejob.co.jp/recruit/

勉強会 LT資料 -> Alexaスキル開発をして分かった VUIの難しさ - Speaker Deck